L’Aube du calcul : Externaliser pour maîtriser

De l’Antiquité à l’époque pré-mécanique (≈ –3000 → XVIᵉ siècle)

L’histoire de l’informatique ne commence ni avec l’électricité, ni avec l’ordinateur, ni même avec la machine. Elle commence avec une nécessité profondément humaine : mettre de l’ordre dans le réel. Compter. Comparer. Prévoir. Décider.

Avant la technique, il y a une limite biologique. La mémoire humaine est fragile. L’attention est instable. Le calcul mental s’épuise vite. Quand une société devient plus complexe, le cerveau seul ne suffit plus. Alors l’humanité invente une stratégie simple et décisive : externaliser. Mettre hors de soi une partie de la mémoire et du calcul, sous forme d’objets, de marques, de règles.

C’est ici que naît l’informatique, au sens le plus profond : non comme une machine, mais comme une méthode de représentation du monde.

La rupture de l’abstraction

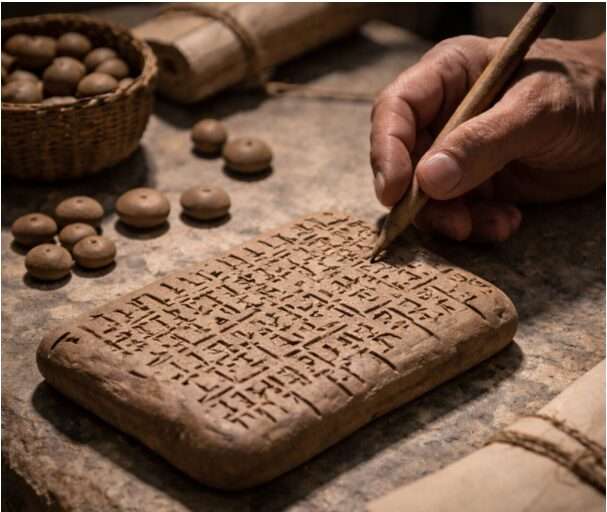

Vers –3000 av. J.-C., en Mésopotamie ou en Chine, un seuil critique est franchi. Compter sur ses doigts ne suffit plus pour gérer les récoltes, le commerce ou l’astronomie. L’homme invente alors le « jeton », la marque sur l’argile.

Ce geste paraît anodin, mais il est révolutionnaire : le nombre se détache de l’objet. On ne compte plus seulement des moutons ou des sacs de grain, on manipule des quantités abstraites. On représente le réel par un symbole pour pouvoir le traiter intellectuellement.

–3000 av. J.-C. : Compter le monde pour mieux l’organiser

Autour de –3000 av. J.-C., un basculement décisif s’opère dans les civilisations de Mésopotamie (notamment en Sumer) et, indépendamment, en Chine.

Les sociétés humaines atteignent alors un seuil critique de complexité.

Le commerce s’étend,

l’agriculture se structure à grande échelle,

l’astronomie commence à cartographier le ciel.

Les outils biologiques de l’homme deviennent insuffisants.

Compter avec les doigts ne permet plus de gérer des récoltes massives, des échanges durables ou une organisation collective étendue.

L’humanité invente alors une réponse révolutionnaire :

des systèmes de représentation.

Jetons, tablettes d’argile, marques gravées transforment profondément le rapport au nombre.

L’objet physique change de nature.

Le nombre devient un outil intellectuel,

détaché de l’objet qu’il représente.

On ne compte plus seulement des moutons ou des sacs de grain présents sous les yeux ;

on manipule désormais des quantités abstraites, des concepts stabilisés dans le temps.

C’est précisément là, dans l’argile des Sumériens, que naît le principe fondamental de toute l’informatique moderne :

représenter le réel sous une forme symbolique afin de pouvoir le traiter.

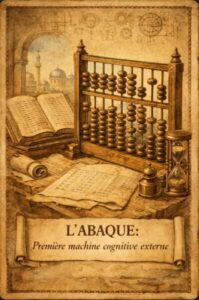

L’abaque : première machine cognitive externe

Dans ce contexte de complexité croissante, apparaît l’abaque.

Utilisé sous différentes formes dès l’Antiquité — de la Mésopotamie à la Chine — il marque une rupture technique majeure.

Ce n’est pas un simple accessoire pédagogique.

C’est le premier dispositif matériel spécifiquement conçu pour le calcul.

Pour la première fois, des objets physiques — pierres, perles, tiges — incarnent des valeurs numériques.

Le calcul cesse d’être une pensée invisible et volatile pour devenir un objet concret, observable et stable.

Il devient alors :

- Visible :

l’état du calcul est affiché en permanence sous les yeux de l’utilisateur. - Manipulable :

l’esprit n’a plus à tout retenir ; la main agit directement sur la pensée. - Transmissible :

le résultat peut être montré, partagé et vérifié par autrui.

L’outil ne pense pas.

Il ne décide rien.

Mais il augmente la capacité cognitive humaine en libérant l’esprit de la charge de mémorisation immédiate.

Plus fondamentalement encore, l’abaque introduit un principe qui demeure au cœur de l’informatique moderne :

le traitement de l’information par unités discrètes.

Chaque perle correspond à une valeur distincte.

Chaque position possède un sens précis.

Le « digital », au sens strict de la manipulation d’unités finies, commence ici —

bien avant l’électronique.

L’abaque est une structure organisée — table, cadre, lignes ou tiges — sur laquelle des éléments mobiles (pierres, perles, jetons) représentent des valeurs numériques.

Le calcul s’effectue par déplacement, non par inscription.

C’est une rupture fondamentale.

Ici, le calcul devient :

- visible :

l’état du raisonnement est affiché sous les yeux. - manipulable :

on déplace des unités pour additionner, soustraire, regrouper. - réversible :

une erreur peut être corrigée immédiatement. - dynamique :

la valeur change sans être figée dans la matière.

L’abaque ne mémorise pas le résultat final.

Il accompagne le raisonnement en temps réel.

L’outil ne pense pas.

Il ne décide rien.

Mais il décharge l’esprit humain d’une partie de l’effort mental, permettant de se concentrer sur la logique plutôt que sur la mémorisation.

Plus profondément encore, l’abaque introduit un principe essentiel, toujours au cœur de l’informatique moderne :

le traitement de l’information par unités discrètes.

Chaque pierre, chaque perle représente une valeur distincte.

Chaque position possède un sens précis.

Le calcul devient une opération sur des états, pas une simple intuition mentale.

C’est ici que commence réellement le calcul externe actif.

Bien avant l’électronique, bien avant les machines mécaniques, l’humanité invente déjà une forme primitive de processeur humain–outil.

L’abaque n’est pas encore un ordinateur.

Mais il en contient déjà l’esprit :

rendre la pensée calculatoire visible, manipulable et fiable.

L’abaque dans la vie quotidienne : un outil social avant d’être technique

L’abaque n’est pas un instrument réservé aux savants.

Il est utilisé par des marchands, des collecteurs d’impôts, des administrateurs, des comptables et des artisans. Là où des quantités doivent être évaluées rapidement, vérifiées et corrigées, l’abaque devient indispensable.

Son rôle dépasse le simple calcul individuel :

il permet de partager un raisonnement. Deux personnes peuvent observer le même état du calcul, discuter d’un déplacement, corriger une erreur. Le calcul sort de la tête d’un seul pour devenir collectif et contrôlable.

C’est une étape essentielle dans l’histoire de l’informatique :

le calcul n’est plus seulement juste, il devient vérifiable.

Fiabilité et contrôle : réduire l’erreur humaine

Avant l’abaque, une erreur de calcul est difficile à détecter.

Avec l’abaque, l’état du calcul est visible à chaque instant. Une incohérence saute aux yeux. Une retenue oubliée peut être corrigée immédiatement.

Ce principe est fondamental :

l’outil ne supprime pas l’erreur humaine, mais il la rend détectable.

On voit apparaître ici une idée clé, toujours centrale dans les systèmes informatiques modernes :

un bon outil ne remplace pas l’humain, il l’aide à se corriger.

Transmettre le calcul : l’abaque comme outil pédagogique

L’abaque joue également un rôle majeur dans la transmission du savoir.

Il permet d’enseigner le calcul de manière structurée, progressive et concrète. Les règles deviennent visibles. Les erreurs deviennent compréhensibles.

Le calcul cesse d’être un talent individuel pour devenir une compétence transmissible.

C’est un pas décisif vers la standardisation des méthodes.

Là encore, l’informatique moderne n’invente rien :

elle prolonge cette idée ancienne selon laquelle une méthode doit pouvoir être apprise, répétée et améliorée.

Un ancêtre du processeur

Sans être une machine au sens moderne, l’abaque introduit déjà une logique essentielle :

- un état initial (position des unités),

- une action (déplacement),

- un nouvel état résultant.

Cette boucle — état, action, nouvel état — est au cœur de tout traitement de l’information, des premiers ordinateurs aux systèmes actuels.

L’abaque n’est pas encore un ordinateur.

Mais il en pose clairement le principe fonctionnel :

traiter l’information par manipulation d’états visibles et discrets.

Synthèse

Avec l’abaque, l’humanité franchit un seuil décisif :

le calcul devient externe, actif, contrôlable et partageable.

Il ne s’agit plus seulement de compter, mais de raisonner avec un outil.

C’est une avancée silencieuse, mais fondamentale, sur laquelle reposera toute la suite de l’histoire de l’informatique.

À propos de l’outil d’écriture : le stylet

À –3000 av. J.-C., il n’existe ni crayon, ni encre, ni taille-crayon.

Les scribes de Mésopotamie utilisent un stylet en roseau, un outil simple, brut et parfaitement adapté à son époque.

Ce stylet n’écrit pas au sens moderne.

Il imprime des marques dans l’argile encore molle.

Fabriqué à partir de roseaux abondants dans la région, il est :

- cassé ou taillé à la main, sans mécanisme,

- doté d’une extrémité pointue ou biseautée,

- irrégulier, organique, non standardisé.

Chaque pression laisse une empreinte plutôt qu’un trait.

C’est de ce geste répété que naît l’écriture cunéiforme.

Ce détail est essentiel :

avant le papier et l’encre, l’information est gravée dans la matière.

Elle est pensée pour durer, être vue, être vérifiée.

Ici encore, l’informatique n’est pas une machine,

mais une méthode humaine pour stabiliser le réel.

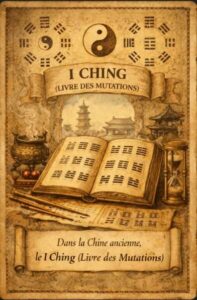

Une révolution silencieuse : la logique binaire avant les machines

En parallèle de l’évolution des outils matériels — comme l’abaque — une autre révolution, plus discrète mais tout aussi décisive, se développe dans le domaine de la pensée pure.

Dans la Chine ancienne, le I Ching (Livre des Mutations), dont les origines remontent au premier millénaire avant notre ère, propose une vision du monde radicalement nouvelle.

Il ne cherche pas seulement à compter, mais à structurer le réel.

Ce système repose sur une représentation symbolique fondée sur des oppositions simples et absolues :

- Lignes pleines (Yang)

- Lignes brisées (Yin)

Ces combinaisons

servent à décrire les transformations, les équilibres et les cycles de la vie.

Sans le savoir, et sans aucune machine, leurs auteurs manipulent pour la première fois une logique binaire.

Il ne s’agit pas encore de calcul automatique, mais l’intuition fondamentale est posée — et elle est vertigineuse :

un monde complexe peut être décrit par une accumulation d’états simples, discrets et opposés.

C’est une rupture intellectuelle majeure.

On comprend que l’infini peut se réduire à une alternative élémentaire.

Des siècles plus tard, cette logique philosophique du « soit l’un, soit l’autre » sera formalisée par les mathématiciens pour devenir le langage universel de toutes nos machines modernes :

le zéro et le un.

Votre ordinateur ne fait, au fond, rien d’autre que manipuler — à une vitesse vertigineuse — cette ancienne intuition du Yin et du Yang.

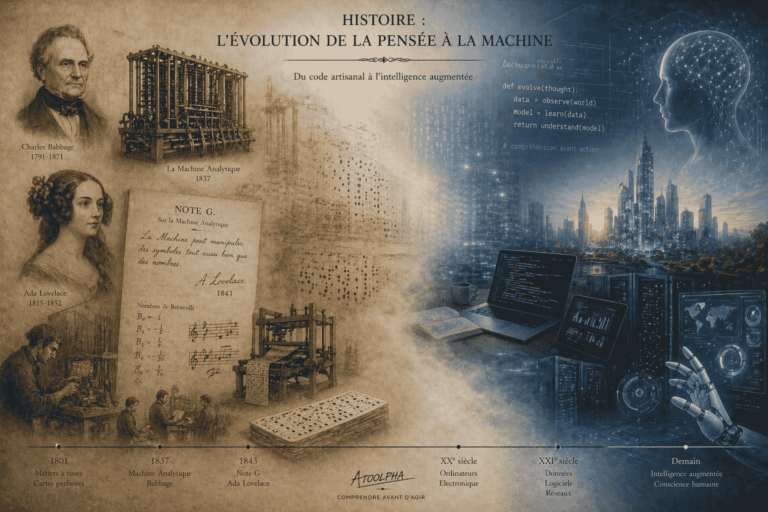

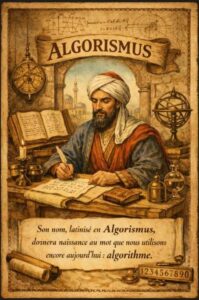

IXᵉ siècle : naissance de l’algorithme

Il est impossible de clore cette période pré-mécanique sans évoquer une rupture majeure, peut-être la plus déterminante de toutes.

Au IXᵉ siècle, à Bagdad, le mathématicien perse Al-Khwarizmi publie des travaux fondamentaux sur la résolution systématique des équations, notamment dans son traité Al-Jabr.

Son apport ne réside pas seulement dans la résolution de calculs complexes, mais dans quelque chose de bien plus profond :

il définit une méthode universelle, une marche à suivre rigoureuse permettant d’atteindre un résultat de manière fiable et reproductible.

Son nom, latinisé en Algorismus, donnera naissance au mot que nous utilisons encore aujourd’hui : algorithme.

Al-Khwarizmi : L’Architecte des Nombres

- La Naissance de l’Algèbre

À travers son traité magistral, le Kitāb al-Jabr, il formalise pour la première fois la résolution d’équations. Le terme « Algèbre » (de l’arabe al-Jabr, signifiant « restauration ») est né de sa plume. - L’Origine de l’Algorithme

Chaque processus logique que nous utilisons aujourd’hui en informatique est un hommage à son nom : « Algorithme » est la latinisation d’Al-Khwarizmi. Il a instauré la rigueur du calcul « étape par étape ». - La Révolution du Zéro

Véritable pont entre l’Orient et l’Occident, il a introduit le système de numération indien dans le monde musulman. En popularisant la numération décimale et le zéro, il a permis l’abandon des calculs complexes en chiffres romains. - Arpenter la Terre et le Ciel

Géographe et astronome, il a coordonné les premières cartographies mondiales et conçu des tables astrales précises. Son travail permettait alors de naviguer, de mesurer le temps et d’organiser la vie religieuse et civile.

« Son œuvre n’était pas une simple théorie : elle répondait aux besoins concrets de son temps — commercer, bâtir et hériter. »

Il est crucial de comprendre ceci :

un algorithme n’est pas une machine.

Ce n’est pas de la technologie.

C’est une méthode pure, une recette intellectuelle.

Pour être valide, un algorithme doit respecter des critères stricts :

- Une suite d’instructions

pas à pas, sans rien sauter. - Ordonnée

l’ordre des étapes est essentiel et modifie le résultat. - Finie

le processus doit s’arrêter à un moment donné ; il ne peut pas tourner indéfiniment. - Sans ambiguïté

chaque instruction doit être claire et ne laisser aucune place à l’interprétation.

C’est l’essence même du logiciel moderne.

Mille ans avant le premier ordinateur, l’être humain avait déjà inventé le « code ».

Avant d’avoir des machines capables d’exécuter automatiquement ces instructions, l’humanité avait déjà construit la logique rigoureuse qui les rend possibles.

Une vérité fondamentale se dessine alors clairement :

le logiciel a précédé le matériel.

Ce que révèle cette première ère

À la fin de cette longue période pré-mécanique, une vérité s’impose — et elle change profondément notre regard sur la technologie moderne :

l’informatique n’est pas née d’une invention soudaine.

Elle n’apparaît pas par magie au XXᵉ siècle avec l’électricité.

Elle est le résultat d’une accumulation lente, patiente et collective d’idées humaines.

Pendant des millénaires, bien avant le premier transistor, l’humanité a construit tout le socle intellectuel indispensable :

- Le calcul

manipuler des symboles pour représenter le réel. - La logique

penser en états simples, opposés, combinables (le binaire). - La méthode

formaliser une suite d’instructions reproductibles (l’algorithme). - L’abstraction

détacher le sens de l’objet pour le rendre manipulable.

Tout cela précède largement la machine.

L’ordinateur, aussi puissant soit-il aujourd’hui, n’a rien inventé de fondamental.

Il ne fait qu’incarner, des siècles plus tard, cette longue maturation intellectuelle.

Il est le corps physique d’un esprit conçu par l’homme bien avant lui.